La réalité des créateurs de vertical drama AI, avec Benjamin Pott

Six points qu'un POC perso financé à la main vient nuancer dans les pitchs vertical drama AI.

Suite de La Dimension Interdite #3. Benjamin Pott (Naralive) répond. Pas un studio capitalisé. Un POC perso qui paie chaque dollar de sa poche. Et qui contredit certaines lectures de marché.

Il y a deux mois, j’ai cramé 120 dollars pour faire un vertical drama AI à partir de mon roman Les Veilleurs Félins. Le héros s’appelle Mistral, c’est un chat borgne. Au treizième frame, l’œil cicatrisait tout seul. J’ai documenté la déroute dans I Spent $120 Trying to Make an AI Vertical Drama About Cats.

Hier, j’ai publié La Dimension Interdite #3. Le format vertical drama bascule en AI. Hongguo n°1 sur ByteDance avec une série 100 pour cent générée. Vigloo livre 22 épisodes en 8 semaines pour 33 000 dollars avec moins de 10 personnes. Le co-fondateur de Holywater déclare code red on AI usage le 30 mars. Le double passe le test du miroir.

J’ai posé mes questions à Benjamin Pott. Fondateur de Naralive. Pas un studio capitalisé. Un POC perso. Je le connais depuis 15 ans. Je l’ai recruté à M6 Web. On a fait Afrostream (YC S15) ensemble, puis Majelan, Kessel, Trace. Il finance Naralive de sa poche. Pas d’investisseur. Pas de crédits gratuits. Chaque dollar dépensé sur Seedance, sur FAL, sur Gemini Veo, c’est son dollar.

Pour situer : FAL (fal.ai) est la plateforme cloud qui héberge la plupart des modèles vidéo AI du marché, Seedance, LTX-2, Kling, Gemini Veo, Wan, et d’autres, derrière une API unifiée. C’est l’infrastructure de référence des solo creators 2026 : tu paies à la scène, sans avoir à gérer les GPU ni les contrats individuels avec chaque éditeur. La facture qui crame 25 balles par scène cassée chez Benjamin, c’est cette facture-là.

Voici ce qui en sort, en six points qui complètent, nuancent et parfois contredisent la lecture que j’ai donnée dans la newsletter du 7 mai.

1. Le pipeline réel, et le vrai goulot que personne ne nomme

J’ai demandé à Benjamin comment ça s’enchaîne vraiment, du script à la vidéo finale, et où ça casse. Sa réponse écrite tient en une phrase :

“L’enchaînement c’est pas une ligne droite, c’est tout un système d’agents qui travaillent ensemble. Tu pars du script, et déjà première grosse réalité : passer d’un texte brut à des shots prêts à filmer en IA, ça demande des centaines d’agents qui collaborent.”

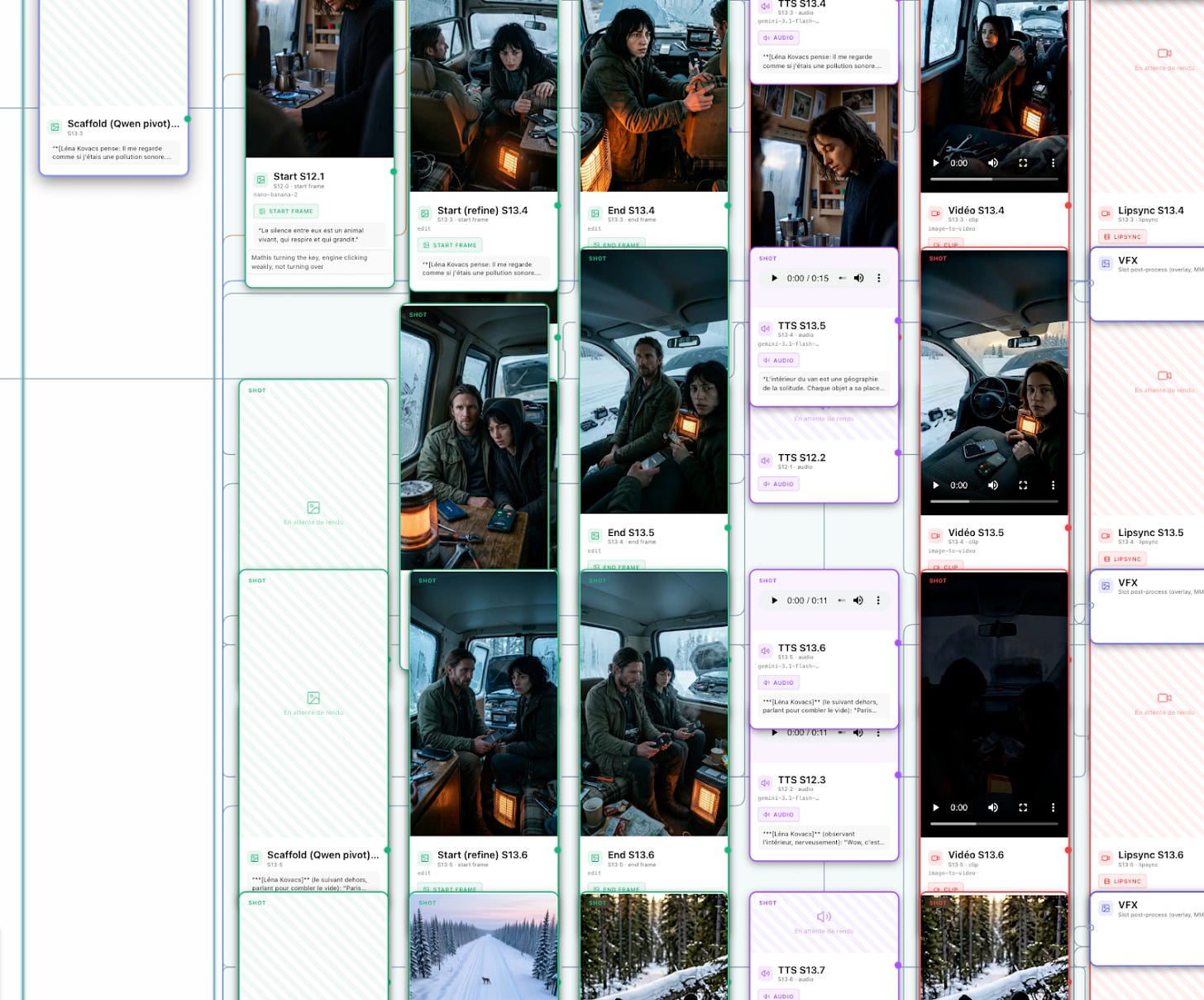

Concrètement chez Naralive : un agent qui découpe l’histoire en scènes et en plans, et pour chaque plan quatre opérations en parallèle. Une image de début, une image de fin générée pour rester cohérente avec la première, la voix, et la vidéo qui interpole entre les deux images. Tout en parallèle, jamais d’attente bloquante.

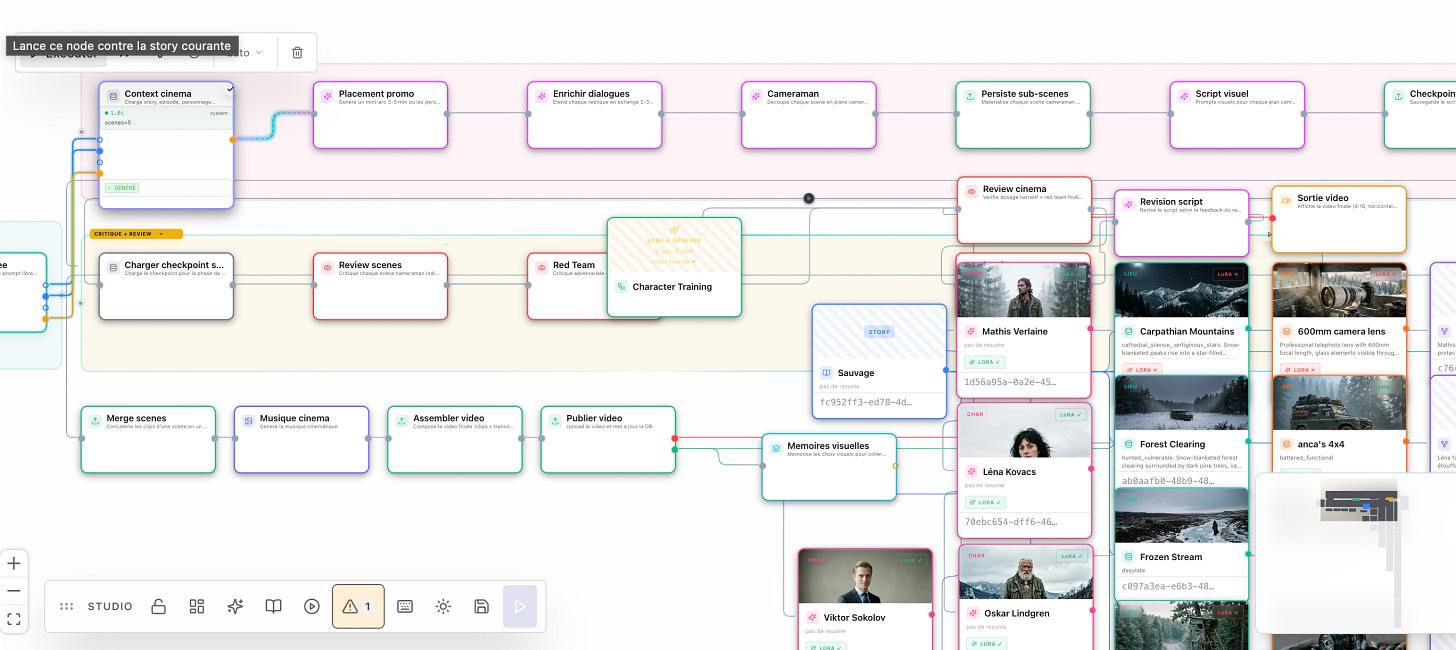

Le grand canvas qu’il m’a montré ressemble à un nœud cérébral : Context cinema, Placement promo, Enrichir dialogues, Cameraman, Persiste sub-scenes, Script visuel, Review cinema, Revision script, Sortie video. Chaque nœud est un agent. Chaque agent fait une chose. L’orchestrateur tient le tout. C’est codé en dur aujourd’hui, mais l’idée est de le rendre conversationnel demain.

Petit détour pour le lecteur non technique : dans le contexte AI, l’orchestration est l’art de faire travailler ensemble plusieurs modèles qui, individuellement, ne savent faire qu’une chose. Un modèle pour le script, un pour la voix, un pour l’image, un pour la vidéo, un pour le lipsync. L’orchestrateur les enchaîne, gère les passages d’état, tranche entre plusieurs résultats, et produit un output final qui aurait été impossible avec un seul modèle. C’est ce qui sépare un creator qui clique trois prompts dans une interface d’un studio qui produit 60 épisodes cohérents. La section 5 creuse pourquoi c’est devenu le vrai battlefield.

Sur ce qui tient solide en 2026 :

“La partie écriture, les modèles type Claude ou GPT pour le scénario, les dialogues, la révision, ça tourne bien. Mais c’est pas gratuit. Avec tous les agents qui débattent, qui valident, qui révisent, qui propagent l’état des personnages d’épisode en épisode, on est plutôt sur 5 à 8 euros minimum par épisode rien que sur la partie narrative.”

Maintenant, le vrai goulot. Et là Benjamin formule un point qui n’est pas dans la newsletter SR :

“C’est l’amont de création. J’ai mis la barre très haute. Je ne veux pas juste générer un plan et qu’un humain valide. Je veux que ce soient les modèles IA et les agents eux-mêmes qui décident quel est le meilleur plan. Une vraie batterie d’agents de production qui collaborent : un agent réalisateur qui propose des cadrages, un agent script qui valide la cohérence narrative, un agent directeur photo qui juge la lumière, un agent monteur qui anticipe le rythme, un agent continuité qui vérifie qu’on respecte les arcs des personnages. Et tous ces agents qui débattent, qui votent, qui itèrent jusqu’à converger sur LE bon plan pour ce moment de l’histoire.”

Et la conclusion qui fait basculer la lecture :

“C’est ça le vrai mur en 2026. Pas la qualité d’un plan isolé. Ça, les modèles te le rendent. C’est l’autonomie créative. Faire en sorte que le système prenne des décisions de mise en scène cohérentes, sans qu’un humain doive arbitrer chaque plan. Et ça personne ne l’a vraiment résolu proprement aujourd’hui.”

Tous les chiffres de la newsletter du 7 mai (Hongguo, Vigloo, Holywater, $26 milliards de marché en 2030) supposent que le mur de la qualité par plan est franchi. Benjamin confirme : c’est franchi. Mais la qualité par plan ne suffit pas pour scaler. Le mur suivant, celui de l’autonomie créative des agents, est intact. C’est lui qui sépare un Hongguo qui pousse 2 000 titres par jour d’un solo creator qui en pousse 22 en deux semaines avant de mourir.

2. Le prix réel d’une scène, hors pitch deck

J’ai demandé à Benjamin ce qu’il dépense vraiment, hors RH, pour produire 90 secondes de vertical drama. Pas la version pitch.

Sa grille écrite :

“Setup budget (Kling Turbo, qualité moyenne) : 25 à 50 dollars par épisode, utilisable en pilote, pas en prod premium. Setup qualité (LTX 2 ou Gemini Veo) : 150 à 400 dollars par épisode quand tu pousses pour la qualité réelle. Setup multimodal premium en mode limité : 500 à 1500 dollars par épisode facilement, parce que 150 euros par scène fois 8 à 10 scènes.”

Sur le call, il a précisé :

“Sur ByteDance, en mode limité, je peux dépenser bien plus que 150 euros sur une seule scène. Pas un épisode. Une scène. Et là je ne parle même pas du coût stable. On entraîne les LoRA, on teste plusieurs modèles en parallèle pour trouver le pipeline parfait. Tu génères la même scène avec Gemini, avec LTX 2, avec Kling, tu compares, tu re-roll, tu ajustes les prompts, tu retrains une LoRA si l’identité dérive.”

Le coût qui passe en off dans tous les pitchs :

“À la fin de la journée, une seule scène a coûté plusieurs centaines d’euros en exploration. Et c’est pas du gaspillage, c’est ça qui te permet ensuite d’industrialiser à 150 dollars la scène en croisière. Mais ce coût d’exploration, personne ne le mentionne dans les pitchs.”

Plus dur encore, sur Seedance précisément :

“Seedance, ça crame du budget. La plupart du temps sur toutes mes scènes, il y en avait cinq sur six qui était en erreur. Et à chaque fois je cramais du crédit, même quand ça fait une erreur, ça te crame du crédit. Une scène de 5 à 10 secondes, ça me cramait 25 balles, 30 balles. Au bout d’un moment j’ai dit stop. Je suis passé sur des modèles à 5 balles la scène qui sont très très bien.”

Et la phrase qui ferme le sujet :

“Le vrai coût d’un drama AI premium aujourd’hui, c’est plus proche du prix d’un court-métrage que d’un TikTok. Quand quelqu’un te dit le contraire, soit il pitche, soit il livre du slop.”

Pour produire 60 épisodes vertical drama AI qui tienne la route, exploration comprise, Benjamin pose un plancher honnête entre 70 000 et 110 000 dollars. Vigloo annonce 33 000 dollars pour 22 épisodes. Holywater dit 10x moins cher que le live-action. Sukudo affiche 2 500 à 5 000 dollars en hindi only. Tous comparent à du tournage live traditionnel. Jamais entre studios AI sérieux. Jamais en intégrant l’exploration.

Ce que la newsletter SR du 7 mai dit du marché à $14 milliards en 2026 et $26 milliards en 2030 reste vrai. Mais ce que cette taille cache, c’est qu’elle est portée par deux producteurs distincts : ceux qui livrent à 5 000 dollars un slop qui mourra en 30 secondes de retention, et ceux qui investissent 70 000 à 110 000 dollars minimum pour produire du regardable. Pas de troisième voie.

3. La cohérence personnage, et le test du chat borgne

J’ai raconté à Benjamin ce que mon test à 120 dollars avait produit : Mistral le chat borgne devenu gris à deux yeux au treizième frame, Marc le photographe blanc traumatisé devenu noir musclé, le filtre safety qui a réécrit le scénario du roman sans demander. Question : qu’est-ce qui marche vraiment en 2026 pour tenir un personnage cohérent sur 50 à 100 épisodes ?

Petit détour pour le lecteur non technique. LoRA, pour Low-Rank Adaptation, est la technique standard 2026 pour entraîner un modèle d’image ou de vidéo à reproduire fidèlement un personnage, un style ou un objet précis. Au lieu de réentraîner le modèle complet (impossible pour un solo creator, c’est des millions de dollars de compute), tu injectes une petite couche d’adaptation qui apprend ton sujet à partir de 10 à 50 images. Le LoRA fait quelques centaines de méga-octets, se branche sur le modèle de base, et garantit que ton personnage ressort identique à chaque génération. C’est ce qui sépare un creator qui a 50 visages différents pour le même personnage d’un creator qui a UN visage. Toute la suite de cette section parle de ça.

La réponse écrite, dense :

“L’entraînement d’identité visuelle (LoRA), c’est lui qui a sa carte. Mais c’est pas un truc qu’on fait une fois au début et qu’on oublie. C’est un système continu. Ce qu’il te faut, c’est un agent de détection de nouveaux éléments qui tourne sur chaque épisode au moment du découpage narratif. Cet agent, son job c’est de scanner le script et de dire : épisode 14, nouveau personnage secondaire, nouvel objet, nouveau lieu. Et là, automatiquement, chaque nouvel élément part en entraînement d’identité.”

Le mécanisme propre du drift que j’ai vécu :

“Sinon voilà ce qui se passe : épisode 14, Sarah apparaît pour la première fois, l’IA génère son visage à la volée, ça donne une certaine tête. Épisode 18, Sarah revient, l’IA re-génère à la volée, c’est pas tout à fait la même tête. Épisode 25, c’est carrément une autre personne. Drift garanti, exactement comme tes problèmes Marc et Mistral.”

Sur le canvas Naralive qu’il m’a montré, chaque personnage récurrent a sa carte LoRA dédiée. Mathis Verlaine (le solitaire des Carpates), Léna Kovacs (la fugitive), Oskar Lindgren (le vieil homme), Viktor Sokolov (le poursuivant). Quatre LoRA, quatre identités verrouillées. Plus les lieux : Carpathian Mountains, Forest Clearing, Frozen Stream, Hunting Hide. Plus les objets clés : 600mm camera lens, anca’s 4x4, dead battery, léna’s broken camera. Chaque élément qui revient a son LoRA. C’est ça la discipline.

Sur le cas précis du chat borgne, Benjamin sur le call :

“J’arrive à gérer une image de chat borgne, mais c’est quand je veux l’animer que ça marche pas. Le chat borgne faut vraiment découper ton personnage. Faut déjà faire un chat qui est enregistré. Le fait qu’il ait perdu un œil, faut l’enregistrer. Donc moi ce que je fais c’est que j’utilise LoRA qui a pré-training de personnages. C’est un modèle dédié pour entraîner la persistance du personnage. Tu génères plein d’images. Une image principale du personnage en mode photographie, ou en dessin animé. En réalité ce qui va te faire un chat assez réel avec un bandeau sur l’œil.”

Mistral n’avait pas son LoRA. Marc n’avait pas son LoRA. Et il n’y avait pas d’agent détecteur pour me signaler qu’il en fallait un. Le drift était inévitable. Le problème n’est pas dans la qualité des modèles, il est dans l’absence de système continu d’identité.

C’est exactement le mur que la newsletter SR ne creuse pas, et qui sépare un solo creator (un Skibidi Tentafruit qui fait 300 millions de vues en 15 jours mais meurt en 22 épisodes parce que sa stack ne tient pas) d’un opérateur sérieux qui peut produire 60 ou 100 épisodes cohérents.

4. Le seuil “Go Prod”, et ce que ça change pour la lecture du marché

Sur le call, j’ai demandé à Benjamin sa définition d’un Go Prod. Ce qui passe le filtre Naralive vs ce qui sort en slop. Sa réponse a renversé ma lecture :

“Il y a deux trois semaines je t’aurais dit Go Prod c’est perfection. C’est meilleur modèle, qualité zoom vraiment super qualité. Vraiment faire un truc le plus propre possible, limite cinéma. Au moins du même niveau qu’un Les Feux de l’amour. Pour moi c’était ça.”

Le pivot :

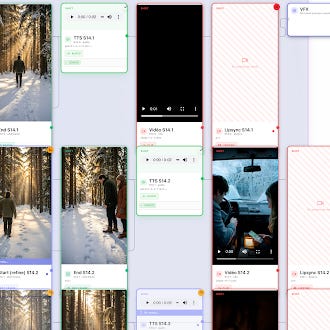

Note pour le lecteur non technique : le lipsync est la technique qui synchronise le mouvement de la bouche d’un personnage avec une piste audio. En production AI 2026, c’est généré dans une étape distincte. Tu produis d’abord la vidéo du personnage qui parle, puis l’audio (TTS ou voix clonée), puis tu animes la bouche pour qu’elle colle au son. Plus la langue est anglophone, plus c’est précis. Plus elle s’éloigne de l’anglais (français, mandarin, arabe), plus le lipsync casse. C’est un des goulots structurants 2026.

“Petit à petit j’ai gratté, parce que je suis nouveau dans ce milieu. J’ai remarqué que tout ce qui était très court à générer par IA était plus simple que du long. Plus tu fais long, plus c’est compliqué. Format publicitaire 15 à 30 secondes, ça c’est court, ça tu arrives à le faire très bien à l’heure actuelle. Le truc qui marche le mieux c’est tu fais un avatar, donc un perso seul qui parle. Tu fais une première image de start, tu animes. Par dessous tu fous un lipsync. Ça marche feu de Dieu. Ça cartonne.”

Et la formulation qui change la grille de lecture :

“Le but final de Seedance et tous les modèles vidéo qui sont sur le marché, c’est de pouvoir fournir un outil qui permet de créer des pubs très rapidement et à tout le monde. Ils sont rendus compte que faire des vidéos longues c’était assez compliqué et ça viendra dans le temps, mais ça demande beaucoup de compute, beaucoup d’argent. Du coup, les formats courts c’est vraiment ce qui va bien. Donc OK, j’ai du monde qui a un produit à vendre. On met une image du produit, une scène, un personnage, et tu me génères une pub. Ça cartonne. Super léché. Caramel qui coule sur ton chocolat. Eau qui coule sur ton parfum.”

Et la conséquence pour la grille SR :

“Les modèles vidéo en 2026 ne sont pas optimisés pour le drama narratif premium. Ils sont optimisés pour la pub 15 à 30 secondes et pour l’avatar TikTok parlant. Ce qui passe le test du miroir aujourd’hui, c’est ça. Pas un drama de 90 secondes scénarisé avec arcs émotionnels.”

Cette phrase reformule entièrement ce que j’ai écrit dans Acte II de la Dimension Interdite #3. Le double passe le test du miroir, oui. Sur la pub. Sur l’avatar. Pas (encore) sur le drama narratif scénarisé scalable. Hongguo numéro un avec Bodhi Linshi sur la mythologie chinoise du Roi Singe, c’est de la fantasy mythologique avec des plans courts et chargés, là où l’AI excelle. Pas un drame psychologique en huis clos. Le double passe le test, mais sur un sous-ensemble du format.

C’est une nuance que j’aurais dû poser dans la newsletter, et que Benjamin pose à ma place.

5. L’orchestration, le vrai battlefield 2026

Question sur le call : où se joue le vrai business AI vertical drama, si la génération est devenue une commodité ?

“Si tu enlèves la partie génération, le business aujourd’hui il est plus dans l’orchestration. Les gars ont pondu un modèle. Maintenant c’est celui qui fera le meilleur tool d’orchestration qui va gagner.”

Et la nuance sur ce qu’est l’orchestration :

“Au début, je voulais faire un outil. Un canvas où tu crées des panels puis tu les connectes entre eux. C’est bien, mais finalement si tu as un Claude qui est connecté à ça, ça va beaucoup plus vite. Tu lui parles directement, il va orchestrer lui-même ce qu’il a besoin. Et puis finalement il va prendre Claude. Va prendre la part de marché parce que finalement tu vas juste connecter tes API entre elles. Claude va générer tout tout seul, il va stocker la mémoire.”

[Image 4 à insérer ici : capture pipeline TTS S14.1 + Vidéo S14.1 + Lipsync S14.1, avec les frames forêt enneigée]

Sur le canvas qu’il m’a montré, chaque scène a un pipeline complet : TTS pour les dialogues, image de start, image de end, vidéo qui interpole, lipsync qui synchronise la bouche, VFX en post. Tout connecté. Tout orchestré. Aujourd’hui par un orchestrateur codé en dur. Demain par un agent conversationnel.

La direction de marché que ça implique :

“Anthropic a sorti hier un truc qui s’appelle dreaming, qui ressemble à ce que fait Hermès. C’est un truc qui permet d’avoir des agents qui apprennent, qui gèrent une mémoire beaucoup plus intelligente que ce qui est fait aujourd’hui. Pour moi Claude finalement commence à être vraiment le gagnant de tout ça. Il arrive à intégrer tous les trucs qui manquaient à Claude, qu’on essaye de faire chacun de son côté en mettant des bases de données vectorielles, des machins, des trucs. Sont en train de le mettre en place.”

Conséquence pour les SaaS qui se sont positionnés sur la couche orchestration :

“Pourquoi les gens construiraient des SaaS alors qu’ils peuvent commencer dans Claude directement ? À l’heure actuelle il y a un marché, mais ce qui va durer dans le temps, c’est pas sûr.”

C’est un point qui reformule la fenêtre code red de Nesvit (12 à 24 mois). Code red sur la production AI vertical drama, oui. Mais derrière la production, il y a une couche d’orchestration. Et cette couche est en train d’être absorbée par les LLM eux-mêmes. Ceux qui construisent un SaaS d’orchestration vidéo en 2026 livrent peut-être leur travail aux fournisseurs de LLM avant même d’avoir trouvé leurs clients.

6. Naralive : qu’est-ce que c’est, et pourquoi un POC perso

J’ai demandé à Benjamin où en est Naralive, ce qu’il construit exactement. Sa réponse écrite est nette :

“Naralive n’est pas une agence de création de vertical drama. L’idée du produit, c’est de permettre des stories illimitées. Une plateforme où des créateurs lancent leurs propres histoires, pas un studio qui prend des commandes à la chaîne.”

Sur le call, il a précisé la stratégie produit :

“Je veux pas juste faire des histoires vidéo et des verticales drames, je veux faire plein de formats différents. Des pubs, des trailers, des présentations d’épisode, etc. Au début je voulais faire un outil. Tu vois où tu crées des panels puis tu les connectes entre eux. Mais finalement si tu as un Claude qui est connecté à ça, ça va beaucoup plus vite.”

[Image 1 à insérer ici : capture canvas Naralive avec les épisodes générés (Léna Kovacs, le van, etc.) et les frames Start/End par scène]

Sur le canvas, c’est lisible : Sauvage (le drame des Carpates avec Mathis et Léna), avec ses scènes générées séquentiellement, ses pivots de plot (la fuite de Léna, le secret des Carpates, le fantôme de la sœur), ses transitions. Pas une production studio. Un outil pour qu’un créateur puisse fabriquer sa story de bout en bout.

Et la posture financière, qui change la lecture entière :

“Naralive aujourd’hui c’est un POC perso. Je finance de ma poche. Pas d’investisseur, pas de crédits gratuits. Chaque dollar que je dépense sur Seedance, sur FAL, sur Gemini, c’est mon dollar. Quand je dis qu’une scène cassée m’a cramé 25 balles, je sais que c’est 25 balles à moi.”

C’est ce qui rend les chiffres précis. Holywater dépense ses dollars Series A. Vigloo dépense ses dollars Series A coréens. Les studios chinois dépensent les dollars ByteDance ou ceux de leurs investisseurs. Benjamin dépense les siens. Quand il pose un plancher à 70 000 dollars pour 60 épisodes, ce n’est pas une projection optimiste pour pitcher un VC. C’est ce qu’il sait qu’il devrait sortir de son compte personnel.

Cette honnêteté économique est rare dans le segment.

Ce que ça change pour la lecture de la Dimension Interdite #3

J’ai écrit le 7 mai que le double passait le test du miroir, que la transmission de prix s’opérait, que la fenêtre code red de Nesvit se refermait par la base. Tout ça reste vrai, mais l’éclairage de Benjamin ajoute quatre couches que la newsletter ne posait pas :

1. Le double passe le test sur la pub et l’avatar, pas (encore) sur le drama narratif premium. Les modèles vidéo 2026 sont optimisés pour le format publicitaire 15 à 30 secondes, pas pour le drame psychologique scénarisé long format. Bodhi Linshi numéro un sur Hongguo, c’est de la mythologie spectaculaire avec plans courts. C’est exactement ce que l’AI sait faire. Le test est passé sur ce sous-ensemble. Le drame psychologique long format reste un mur.

2. Le coût plancher pour produire du regardable est 5 à 10 fois ce que les pitchs annoncent. 70 000 à 110 000 dollars pour 60 épisodes en vertical drama AI sérieux, exploration comprise. Vigloo à 33 000 dollars pour 22 épisodes, c’est entre studios capitalisés avec accès aux pipelines d’optimisation. Le solo creator qui croit produire à 5 000 dollars produit du slop qui meurt en 30 secondes de retention.

3. Le vrai battlefield 2026 n’est pas la génération, c’est l’orchestration. Et cette couche est en train d’être absorbée par les LLM eux-mêmes. Anthropic a sorti dreaming pour la mémoire des agents. Les SaaS d’orchestration vidéo qui se positionnent en 2026 sur la couche que Claude est en train d’intégrer nativement risquent de livrer leur travail à leurs propres fournisseurs avant d’avoir trouvé leurs clients.

4. L’Europe AI vertical drama existe aussi en mode solo POC. Holywater est ukrainienne, je l’ai mentionné dans la newsletter. Mais l’Europe AI ne se résume pas à un acteur capitalisé. Elle existe aussi par des opérateurs comme Benjamin, qui financent leur POC de leur poche, avec leur expertise media accumulée sur 25 ans. Ce n’est pas une chaîne de valeur visible dans les dashboards Crunchbase. C’est une infrastructure cognitive qui se construit en parallèle, sans capital, et qui livre des chiffres terrain plus précis que ceux des boîtes capitalisées qui ont des intérêts à pitcher.

Benjamin Pott est fondateur de Naralive, plateforme AI storytelling en POC perso. Son profil LinkedIn. Disclosure : Benjamin et moi travaillons ensemble depuis 15 ans, M6 Web, Afrostream (YC S15), Majelan, Kessel, Trace. Cet article n’est pas une interview neutre, c’est un échange entre deux personnes qui ont construit des pipelines media côte à côte sur cinq boîtes successives.

Cette édition spéciale fait suite à La Dimension Interdite #3 : Le Vertical Drama bascule en AI, publiée le 7 mai 2026.

Merci pour cette discussion, et merci pour la mise en lumières 💡