I'IA, le RAG, VLQA et Netflix : une tentative de vulgarisation

Vous n'avez rien compris au titre ? Lisez la suite.

Pour faire suite au Streaming Radar #2 sur l’IA posté hier, un article scientifique a été recemment publié qui propose une nouvelle façon d’utiliser les larges librairies vidéo (pour le meilleur ?)

1. Introduction

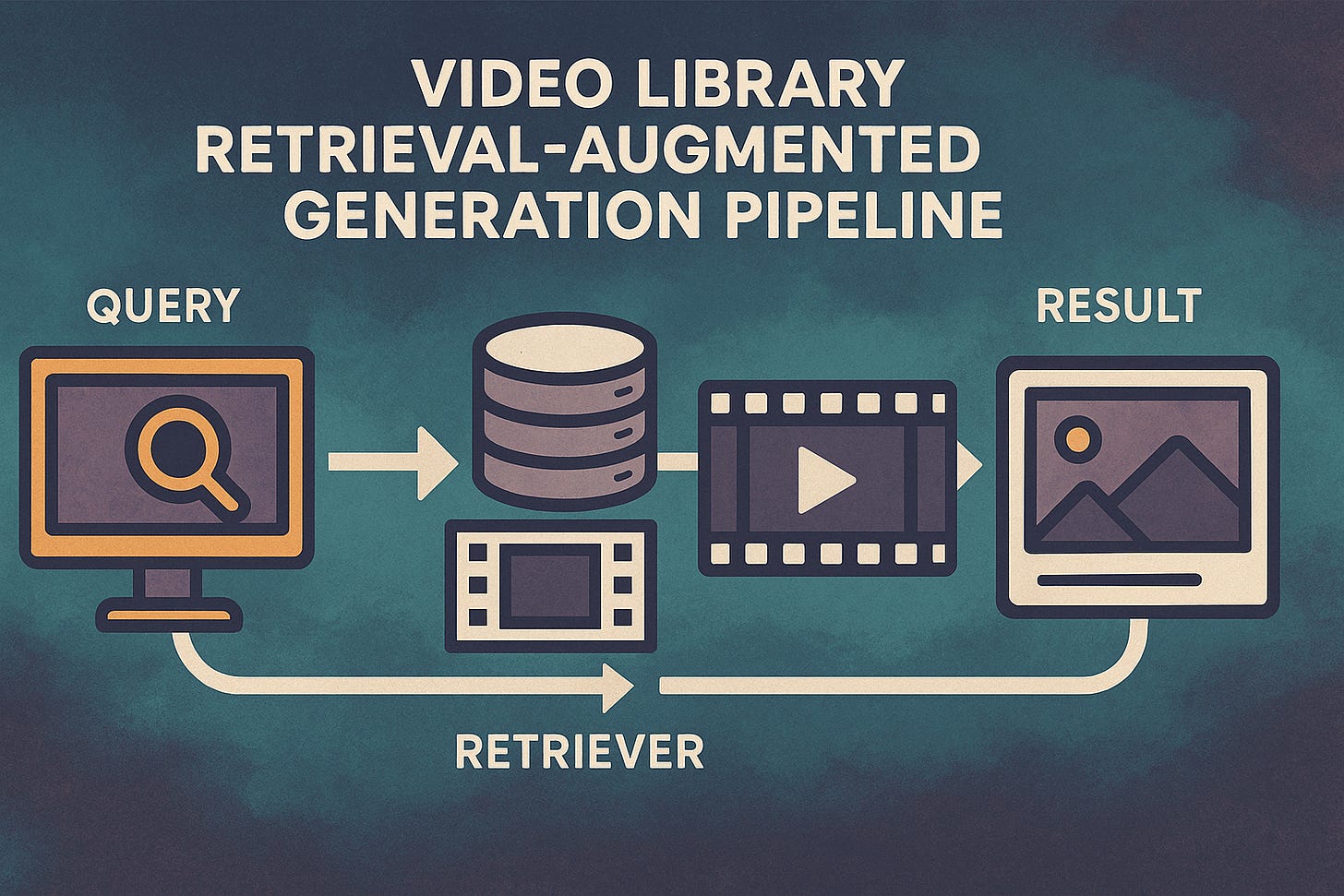

Bienvenue dans l’ère du Retrieval-Augmented Generation (RAG) vidéo, où ton IA ne se contente plus de recommander un titre mais assemble pour toi les séquences clés en quelques secondes. Imagine un moteur capable de parcourir transcriptions, métadonnées et captions, d’isoler les passages pertinents (« retrieval »), puis de reformuler ta requête et d’organiser les extraits dans une réponse narrative (« augmented generation »).

En pratique, tu poses une question naturelle — « Où parle-t-on de l’atterrissage sur Mars ? » — et le système :

repère en un clin d’œil tous les segments correspondants,

produit un résumé clair,

te donne les timestamps (hh:mm:ss) pour naviguer directement dans la vidéo.

C’est ce que l’article nomme le Video Library Question Answering (VLQA) : un assistant multimédia qui rend la recherche dans des archives vidéo aussi simple qu’une conversation. Ces démonstrations, issues du blog de Moments Lab (RAG video libraries ) et du papier scientifique “Towards Retrieval Augmented Generation over Large Video Libraries ” de Yannis Tevissen, Khalil Guetari et Frédéric Petitpont, ouvrent la voie à de nouveaux usages chez Netflix, Prime Video et Disney+.

2. Cas d’usage chez les plateformes de streaming

(Exemples hypothétiques, illustrant simplement les conséquences potentielles de la recherche RAG et susceptibles d’être expérimentés en interne par Netflix, Prime Video, Disney+ et tous les autres.)

Grâce aux avancées du RAG vidéo, les plateformes pourraient :

Générer des bandes-annonces dynamiques en temps réel, adaptées au profil de chaque abonné : intro contemplative pour les amateurs de slow TV, montage percutant pour les fans d’action.

Optimiser automatiquement les vignettes d’accueil en sélectionnant les plans les plus engageants, augmentant ainsi le taux de clics et la découverte de nouveaux contenus.

Améliorer la recherche interne multimodale, permettant à l’utilisateur de poser des questions en langage naturel (« scènes d’humour noir », « coulisses de tournage ») et d’obtenir directement les extraits pertinents avec timestamps.

Proposer des recommandations vidéo enrichies, où un extrait court précède la suggestion de titre, pour accélérer la prise de décision et prolonger le temps de session.

Créer des compilations thématiques à la demande, idéales pour les réseaux sociaux ou pour des formats éducatifs : montages d’instantanés clés (Marvel, Disney, documentaires), ouvrant de nouvelles opportunités de monétisation premium.

Ces fonctionnalités ne sont pour l’instant que le fruit d’une recherche académique, mais elles montrent bien comment le RAG appliqué à la vidéo pourrait révolutionner la façon dont les géants du streaming conçoivent la promotion, la découverte et la valorisation de leurs catalogues.

5. Enjeux et perspectives Enjeux et perspectives

Qualité des métadonnées : le nerf de la guerre. Plus elles sont précises (diarisation, captions), plus la RAG's vidéo est solide (Moments Lab blog).

Hallucinations IA : vigilance indispensable pour éviter des séquences hors-contexte.

Réglementation : droits d’auteur, usage équitable, et conditions de licence des extraits.

6. Conclusion

Les géants du streaming sont à l’orée d’une révolution créative : de la découverte à la promotion, tout devient modulable à la demande. Gardons un œil critique : l’automatisation promet du spectaculaire, à condition de maîtriser les dessous techniques et légaux.

Tu veux creuser davantage ? Jette un œil au papier complet : Towards Retrieval Augmented Generation over Large Video Libraries

Et découvre l’architecture détaillée sur le blog de Moments Lab : RAG video libraries